Шахназаров назвал Максима Виторгана «испуганным патриотом»

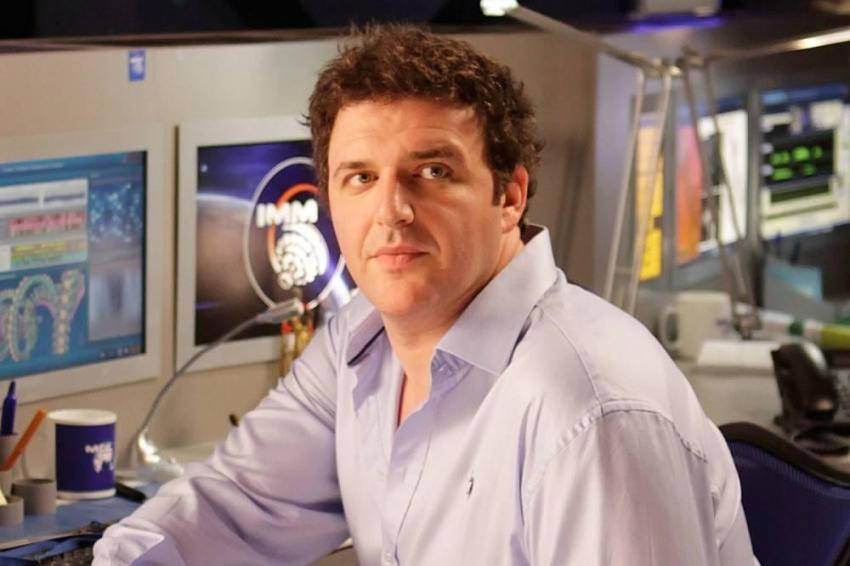

Некоторое время назад Максим Виторган дал интервью Михаилу Шацу (Включен в реестр физических лиц, выполняющих функции иностранного агента в России). Михаил Шахназаров признался, что посмотрел начало этого разговора. Иноагент Шац появился на видео в кепке и наушниках. Публицист усомнился в том, что это правило хорошего тона, сочтя, что такая одежда говорит о комплексах. Рядом с Шацем оказался Максим Виторган. Его Шахназаров отнес к категории «испуганных патриотов».

«А рядом Виторган - выдающийся актер современности. Сколько там у него «Оскаров»? Пятнадцать?» - саркастично отметил журналист.

По словам Шахназарова, судя по разговору, для Виторгана теперь в России не жизнь. При этом публицист порекомендовал артисту обратить свой взор на Израиль. Если ему так плохо на родине и «орки у него отнимают жизнь», следует подумать об этом государстве, где «все мирно, дешево и для людей». По словам журналиста, Виторган относится к категории испуганных патриотов.

«Сейчас не жизнь, а потом начнется жизнь. Ну, вам ли жаловаться?» - поинтересовался публицист.

Напомним, Максим Виторган в последнее время почти не появляется в России. Более того, актер осуждает действия родной страны.

Источник: teleprogramma.pro

Обсудим?

Смотрите также: